Hardware für lokale KI-Systeme

Leistungsfähige KI beginnt nicht in der Cloud – sondern mit der richtigen Hardware.

Für Unternehmen, die sensible Daten verarbeiten oder maximale Performance benötigen, setzen wir auf dedizierte, lokale KI-Infrastruktur.

Je nach Anwendungsfall – von Inferenz bis High-End-Training – konfigurieren wir Systeme, die exakt auf Ihre Workloads abgestimmt sind.

GPU-Beschleunigung für KI-Workloads

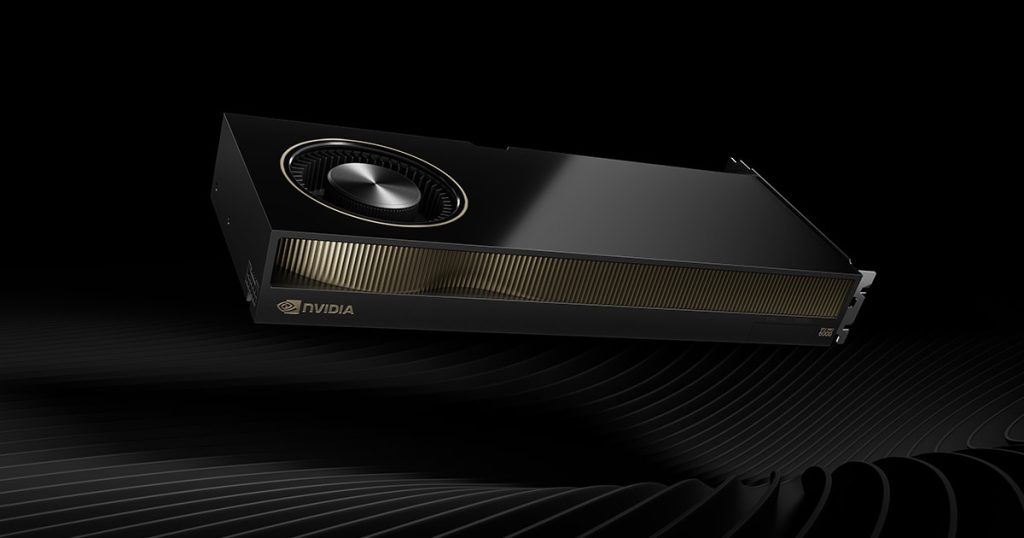

NVIDIA RTX PRO 6000 Blackwell Max-Q

Eine der modernsten Workstation- und KI-GPUs auf Basis der Blackwell-Architektur.

Technische Spezifikationen

(Beispielkonfiguration)

- Architektur: NVIDIA Blackwell

- VRAM: 96 GB GDDR7 ECC

- Speicherbandbreite: ~1,5–2 TB/s (je nach Ausführung)

- CUDA Cores: > 20.000

- Tensor Cores: 5. Generation

- RT Cores: 4. Generation

- FP8 / FP16 / BF16 / FP32 Unterstützung

- Multi-Instance GPU (MIG) Unterstützung

- PCIe Gen5

- Leistungsaufnahme: ca. 300–600 W (je nach Profil)

Typische Einsatzbereiche

- Lokale LLM-Inferenz (70B+ Modelle quantisiert)

- Fine-Tuning von Sprachmodellen

- Computer Vision

- Multimodale KI-Systeme

- KI-Middleware mit hohem Durchsatz

! Für größere Projekte kombinieren wir mehrere GPUs pro System.

KI-Server im Rack

Skalierbare Rechenleistung

Für Unternehmen mit Serverraum oder Rechenzentrum setzen wir auf dedizierte Rack-Server.

Was bedeutet HE (Höheneinheit)?

HE = Höheneinheit

1 HE = 1,75 Zoll (44,45 mm)

Typische Servergrößen:

- 1 HE → sehr kompakt, begrenzte GPU-Kapazität

- 2 HE → ideal für 2–4 GPUs

- 4 HE → High-Performance-Systeme mit 4–8 GPUs

Beispiel: 4 HE KI-Server (High-Performance)

Beispielkonfiguration

- Gehäuse: 4 HE Rackmount

- CPUs: 2× AMD EPYC oder Intel Xeon (je 32–64 Cores)

- RAM: 256 GB – 1 TB ECC DDR5

- GPUs: 4–8× RTX PRO 6000 Blackwell

- Storage:

- 2× NVMe SSD (System, RAID1)

- 4× NVMe U.2/U.3 (Daten, RAID10 optional)

- Netzwerk:

- 10 / 25 / 100 Gbit Ethernet

- Optional InfiniBand

- Redundante Netzteile (2× 1600W+)

- IPMI Remote Management

Vorteile

- Extreme Parallelisierung

- Skalierbar

- Redundante Stromversorgung

- 24/7 Dauerbetrieb ausgelegt

- Ideal für mehrere KI-Modelle gleichzeitig

2 HE Server – Kompakte Unternehmenslösung

Beispielkonfiguration

- 2 HE Rackmount

- 1–2 CPUs (32–64 Cores)

- 128–512 GB ECC RAM

- 2–4 GPUs

- 10–25 Gbit Netzwerk

- NVMe Storage

Ideal für:

- Interne KI-Assistenten

- Dokumentenanalyse

- Lokale Chatbots

- KI-gestützte Automatisierung

Desktop-Workstation

(wenn kein Serverrack vorhanden ist)

Nicht jedes Unternehmen verfügt über einen Serverraum oder 19-Zoll-Rack.

Für diesen Fall bauen wir leistungsstarke KI-Workstations im Tower-Format.

High-End KI-Desktop

Beispielkonfiguration

- Gehäuse: Full-Tower mit optimiertem Airflow

- CPU: AMD Threadripper Pro / Intel Xeon W

- 128–512 GB DDR5 RAM

- 1–2× RTX PRO 6000 Blackwell

- 2× NVMe Gen4/Gen5 SSD

- 10 Gbit Ethernet optional

- 1200–2000W Netzteil

- Geräuschoptimierte Kühlung

Vorteile

- Kein Rack erforderlich

- Ideal für Büroumgebungen

- Wartungsfreundlich

- Kosteneffizienter Einstieg

- Perfekt für einzelne Fachabteilungen

Storage & Datensicherheit

Für KI-Systeme ist Datendurchsatz entscheidend.

Wir setzen auf:

- NVMe Gen4 / Gen5 SSDs

- RAID 1 / RAID 10

- Verschlüsselte Datenträger

- Backup-Strategien lokal oder hybrid

- Optional: Air-Gapped Systeme für höchste Sicherheitsanforderungen

Netzwerk & Integration

Je nach Unternehmensgröße:

- 10 Gbit Ethernet (Standard für KI)

- 25 Gbit für hohe Last

- 100 Gbit für Rechenzentrumsumgebungen

- VLAN-Segmentierung

- Integration in bestehende Infrastruktur

Warum lokale KI-Hardware?

- Volle Datenkontrolle

- Keine Cloud-Abhängigkeit

- DSGVO-konform

- Keine laufenden API-Kosten

- Vorhersehbare Investitionskosten

- Maximale Performance

Von der Analyse bis zur Inbetriebnahme

Wir liefern nicht nur Hardware, sondern eine betriebsbereite Lösung:

- Bedarfsanalyse

- Dimensionierung der Hardware

- Installation & Konfiguration

- Einrichtung der KI-Modelle

- Integration in Ihre Systeme

- Wartung & Support

Fazit

Die richtige Hardware entscheidet über:

- Modellgröße

- Geschwindigkeit

- Skalierbarkeit

- Sicherheit

- Zukunftsfähigkeit

Ob 2 HE-Server, 4 HE-GPU-Cluster oder leistungsstarke Desktop-Workstation – wir konzipieren Ihre lokale KI-Infrastruktur exakt passend zu Ihrem Anwendungsfall.